Per calibrare un array di antenne radar, usa il test in campo lontano (distanza minima 10× lunghezza d’onda dell’antenna) con un’antenna a tromba di riferimento. Esegui l’allineamento di fase usando un analizzatore di rete vettoriale (tolleranza ±5°) e la normalizzazione dell’ampiezza (risoluzione 0.5dB).

Applica gli algoritmi di beamforming per regolare i ritardi degli elementi (precisione 1ns) e convalida con misurazioni RCS su sfere di calibrazione (errore <1dBsm). Conduci test di purezza della polarizzazione (cross-pol ≤-25dB) con un dipolo rotante. Documenta i pattern con incrementi di 1° in azimut/elevazione per la ripetibilità. Ricalibra ogni 500 ore operative o dopo shock meccanici.

Table of Contents

Configurazione base del segnale di test

Prima di calibrare un array di antenne radar, hai bisogno di un segnale di test affidabile per misurare le prestazioni. Una configurazione standard utilizza un segnale a onda continua (CW) da 10 dBm alla frequenza operativa del radar (ad esempio, 9.4 GHz per i sistemi a banda X). Il generatore di segnale dovrebbe avere un rumore di fase inferiore a -100 dBc/Hz con un offset di 10 kHz per evitare di distorcere le misurazioni.

Per gli array a fase con 32 a 64 elementi, un livello del lobo laterale di -30 dB è tipico, quindi il segnale di test deve essere sufficientemente pulito per rilevare deviazioni piccole come 0.5 dB in ampiezza o 3° in fase.

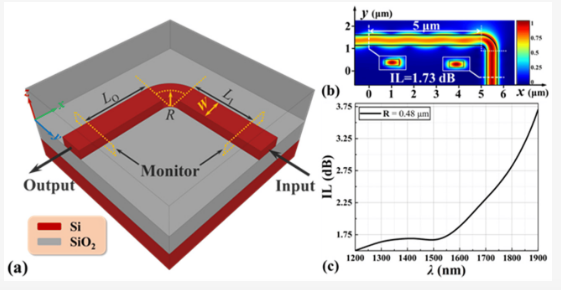

La configurazione di test include solitamente un analizzatore di rete vettoriale (VNA) con un range di frequenza che copre almeno ±500 MHz intorno alla frequenza centrale per catturare la deriva. Un cavo coassiale da 1 m con ≤ 0.5 dB di perdita di inserzione collega il generatore di segnale a un’antenna a tromba di riferimento posizionata da 5 a 10 metri dall’array in prova. Questa distanza garantisce condizioni di campo lontano per le antenne con un’apertura di 0.5 m² o più grande. Se il radar opera in modalità pulsata, il segnale di test dovrebbe imitare la sua larghezza dell’impulso (ad esempio, 1 µs) e PRF (ad esempio, 1 kHz) per corrispondere alle condizioni reali.

L’accuratezza della calibrazione dipende dalla stabilità del segnale. Le fluttuazioni di temperatura di ±2°C possono introdurre una variazione di guadagno di 0.1 dB, quindi il laboratorio dovrebbe mantenere 23°C ±1°C. L’umidità sopra il 60% RH può causare una perdita di inserzione di 0.05 dB nei cavi, quindi tienila sotto il 50% RH. Per gli array a fase attivi, l’ampiezza e la fase di ogni elemento devono essere misurate con una tolleranza di ±0.2 dB e ±2° per garantire l’accuratezza del beamforming. Se l’array utilizza il beamforming digitale, il segnale di test dovrebbe includere la modulazione IQ per verificare la linearità della banda base con un errore dell’1%.

Per convalidare la configurazione, inietta un passo di ampiezza noto di 0.5 dB o uno sfasamento di 10° e conferma che il sistema lo rileva con un errore di ±0.1 dB e ±1°. Se il radar ha il nulling adattivo, testa con due segnali distanziati di 20 MHz per controllare il rifiuto delle interferenze. Registra il rumore di fondo di base (ad esempio, -90 dBm per una RBW di 100 kHz) per distinguere i difetti reali dal rumore di misurazione. Senza un segnale di test stabile, gli errori di calibrazione possono sommarsi, portando a errori di puntamento del fascio di 2-3 dB o una perdita del 10% nel raggio di rilevamento.

Misurare le differenze di fase

L’allineamento di fase è la spina dorsale delle prestazioni di un array a fase – un errore di fase di 5° su soli 4 elementi adiacenti a 10 GHz può distorcere il fascio principale di 0.4°, equivalente a mancare un bersaglio di 1m² a 8km di distanza. I moderni array a 64 elementi richiedono un’adeguamento di fase entro ±2° per mantenere i livelli del lobo laterale di -30dB, richiedendo sistemi di misurazione con risoluzione di ±0.3° e ripetibilità ≤0.05°.

Il processo di misurazione inizia stabilendo un canale di riferimento (tipicamente l’elemento #32 in un array a 64 elementi) utilizzando un segnale CW a 10GHz a +10dBm. La fase di ogni elemento viene quindi misurata rispetto a questo riferimento con un analizzatore di rete vettoriale (VNA) configurato per:

- Larghezza di banda IF: 100Hz (riduce il rumore di fondo a -110dBm)

- Media: 16 sweep (migliora l’accuratezza a ±0.2°)

- Impedenza della porta: 50Ω (tolleranza ±0.05Ω)

Parametri critici di misurazione della fase

| Parametro | Specificazione | Metodo di misurazione | Tolleranza |

|---|---|---|---|

| Fase da elemento a elemento | 0-360° | Fase VNA S21 | ±1.5° |

| Stabilità di fase (15min) | N/A | Registrazione nel dominio del tempo | ≤0.3° di deriva |

| Coefficiente di temperatura | -0.5°/°C | Test in camera termica | ±0.1°/°C |

| Sensibilità alla frequenza | 2°/100MHz | Test a frequenza variabile | ±0.5°/100MHz |

Per gli array a fase attivi, le misurazioni di fase devono tenere conto delle variazioni del modulo T/R:

- Gli amplificatori GaN mostrano uno sfasamento di 0.8° per ogni 1dB di variazione di guadagno

- Gli sfasatori al silicio mostrano un errore di quantizzazione di ±1.5°

- L’accoppiamento reciproco tra elementi a una distanza λ/2 induce una perturbazione di fase di 1.2-2.5°

Il test di produzione richiede una mappatura di fase automatizzata che può misurare tutti i 64 elementi in <90 secondi mantenendo un’accuratezza assoluta di ±0.5°. Il processo deve compensare:

- Differenze di lunghezza del cavo (1cm = errore di 3.6° a 10GHz)

- Ripetibilità del connettore (±0.3° per ciclo di accoppiamento/disaccoppiamento)

- Ripple dell’alimentazione (100mVpp causa una modulazione di fase di 0.2°)

La calibrazione sul campo presenta sfide aggiuntive:

- Il carico del vento su grandi array induce errori di fase meccanici di 0.1-0.3°

- Il riscaldamento solare crea gradienti di 5-8°C causando una deriva termica di fase di 2-4°

- La vibrazione da attrezzature vicine aggiunge un rumore di fase casuale di ±0.5°

L’analisi dei dati dovrebbe segnalare:

- Valori anomali statistici (>3σ dalla fase media)

- Pattern spaziali (elementi adiacenti che mostrano un delta >2°)

- Tendenze di frequenza (pendenza >1.5°/100MHz)

La correzione dell’errore di fase tipicamente comporta:

- Compensazione digitale (applicazione di un offset di -2.3° all’elemento #17)

- Regolazione hardware (taratura della linea di ritardo di 0.7ps)

- Gestione termica (riduzione del riscaldamento locale di 4°C)

Il test di convalida deve confermare:

- Accuratezza del puntamento del fascio (errore <0.15° a 30° di scansione)

- Livelli dei lobi laterali (≤-28dB entro un settore di ±20°)

- Profondità di annullamento (>35dB ad angoli specificati)

Regolare i livelli di ampiezza

Regolare correttamente i livelli di ampiezza in un array radar non riguarda solo la potenza—si tratta di bilanciare ogni elemento entro ±0.2 dB per evitare di distorcere il fascio. Un tipico array a fase a 32 elementi potrebbe avere un guadagno nominale di 25 dB per canale, ma se solo un elemento è sfasato di 1 dB, i lobi laterali possono salire 3-5 dB più in alto, rovinando le prestazioni di rilevamento. Per i radar a banda X (8-12 GHz), errori di ampiezza piccoli come 0.5 dB possono spostare la direzione del fascio di 0.1°, sufficiente per mancare un bersaglio di 1 m² a 15 km.

Il primo passo è misurare l’uscita di ogni elemento con un sensore di potenza calibrato (accuratezza ±0.1 dB) o un analizzatore di spettro (RBW ≤ 100 kHz per evitare che il rumore falsi i risultati). Se l’array usa amplificatori di potenza GaN, aspettati una variazione di guadagno di ±0.3 dB su un’escursione di temperatura di 20°C, quindi stabilizza il laboratorio a 23°C ±2°C. Per i sistemi di beamforming digitale, controlla la linearità del DAC—una non linearità dello 0.5% nell’uscita analogica può introdurre una ripple di ampiezza di 0.2 dB sull’array.

Suggerimento Pro: Normalizza sempre le misurazioni a un elemento di riferimento (di solito quello centrale) per annullare gli errori sistemici da cavi e connettori.

Gli array attivi necessitano di una calibrazione per canale—se un modulo T/R è 1 dB più caldo del resto, può causare uno sbandamento del fascio ad alti angoli di scansione (> 30° fuori asse). Usa attenuatori variabili (passo ≤ 0.1 dB) o un controllo di guadagno digitale (risoluzione ≤ 0.05 dB) per correggere i disallineamenti. Per i sistemi massive MIMO sub-6 GHz, la riduzione dell’ampiezza (ad esempio, -12 dB sui bordi) riduce i lobi di griglia ma richiede una precisione di ±0.15 dB per funzionare.

Errori comuni:

- Ignorare gli effetti del VSWR—un disallineamento di 1.5:1 all’ingresso di un elemento può riflettere il 10% della potenza, causando errori di misurazione di 0.4 dB.

- Trascurare il ciclo di lavoro—i radar pulsati con un ciclo di lavoro del 10% hanno bisogno di sensori di potenza di picco, non di quelli a lettura media.

- Assumere una risposta in frequenza piatta—anche una ripple di ±0.2 dB su una larghezza di banda di 500 MHz distorce i fasci a banda larga.

La convalida finale comporta il test del pattern in campo lontano—se i lobi laterali superano -25 dB o il fascio principale scende 1 dB sotto le specifiche, ricontrolla le ampiezze. Un array a 64 elementi con uno squilibrio di ±0.5 dB perde il 12% del raggio effettivo e il 20% della capacità di rifiuto delle interferenze.

Per le linee di produzione, i tester automatizzati possono regolare più di 100 array al giorno con una consistenza di ±0.15 dB, mentre la regolazione manuale richiede 5-10 minuti per array. Documenta ogni regolazione—un singolo errore di 0.3 dB nei dati di calibrazione può sommarsi in una distorsione della forma del fascio di 2 dB dopo 6 mesi di deriva.

Verificare la direzione del fascio

Ottenere la direzione del fascio corretta è ciò che distingue un radar ad alte prestazioni da uno che manca i bersagli. Un errore di puntamento del fascio di 0.5° in un radar con raggio di 10 km si traduce in un errore di posizione di 87 m—abbastanza per mancare completamente un piccolo drone. Per un array a fase con 32 elementi che opera a 10 GHz, il fascio dovrebbe sterzare entro ±0.2° dall’angolo comandato, altrimenti i lobi laterali possono degradare di 3-5 dB, riducendo l’affidabilità del rilevamento. Se il sistema utilizza il beamforming digitale con sfasatori a 12 bit, ogni passo LSB (Least Significant Bit) dovrebbe corrispondere a un movimento del fascio di ≤ 0.05°—qualsiasi cosa più grossolana rischia che appaiano lobi di quantizzazione ad angoli di scansione di ±30°.

Per verificare la direzione del fascio, inizia con un banco di prova in campo lontano dove la distanza (D) soddisfa la condizione di Fraunhofer (D ≥ 2L²/λ, dove L è la dimensione dell’array). Per un array a banda X largo 0.5 m (10 GHz), la distanza minima di test è 16.7 m. Usa un’antenna a tromba a guadagno standard come ricevitore, posizionata su uno stadio rotante di precisione (accuratezza ±0.01°) per misurare il picco del lobo principale. Se l’array è progettato per una scansione elettronica di ±45°, testa con incrementi di 5°—qualsiasi sbandamento del fascio > 0.3° sulla frequenza (ad esempio, 9-10 GHz) indica errori di calibrazione di fase.

Gli array attivi con moduli T/R integrati devono essere testati in condizioni termiche realistiche. Un aumento di temperatura di 5°C negli amplificatori basati su GaN può introdurre una deriva del fascio di 0.1° a causa delle variazioni dello sfasatore. Per i radar di grado militare, il fascio deve rimanere entro 0.1° dal bersaglio anche dopo 50 ore di funzionamento continuo. Se il sistema utilizza unità di ritardo temporale (TDU) per segnali a banda larga (larghezza di banda di 500 MHz), verifica che lo sbandamento del fascio rimanga < 0.15° su tutta la banda—altrimenti, il guadagno di compressione dell’impulso cala di 1-2 dB.

La scansione in campo vicino è un’alternativa per i laboratori con spazio limitato. Uno scanner planare in campo vicino con una distanza della sonda di λ/10 (3 mm a 10 GHz) può ricostruire il pattern in campo lontano con un’accuratezza di ±0.1°, ma richiede 5-10 minuti per scansione per un array a 64 elementi. Confronta i risultati con i pattern simulati—se il lobo principale misurato è 0.3° fuori o i lobi laterali sono 2 dB più alti, ricalibra le impostazioni di fase e ampiezza.

Registrare i risultati di calibrazione

La calibrazione non è completa finché non è documentata—un singolo dato mancante può invalidare mesi di lavoro. Per un array a fase a 32 elementi, la registrazione dell’ampiezza (±0.1 dB) e della fase (±0.5°) per ogni elemento genera 64 punti dati per frequenza. Se il radar opera su una larghezza di banda di 500 MHz, campionata a intervalli di 50 MHz, si tratta di 704 punti dati per array. Senza una corretta registrazione, una deriva di 0.2 dB in un canale potrebbe passare inosservata finché il fascio non punta 0.3° fuori, riducendo il raggio di rilevamento dell’8%.

I formati di dati strutturati sono non negoziabili. Un tipico file di calibrazione dovrebbe includere:

| Parametro | Tolleranza | Misurazione | Timestamp | ID Operatore |

|---|---|---|---|---|

| Guadagno Elemento 1 | ±0.2 dB | 24.1 dB | 2025-08-04 14:35 | OP-47 |

| Fase Elemento 1 | ±2° | 12.3° | 2025-08-04 14:36 | OP-47 |

| Angolo del fascio @10° cmd | ±0.2° | 9.8° | 2025-08-04 14:40 | OP-47 |

| Livello del lobo laterale | ≤-25 dB | -26.2 dB | 2025-08-04 14:42 | OP-47 |

Per gli ambienti di produzione, i sistemi automatizzati registrano più di 100 array al giorno, taggando ciascuno con un codice QR unico e dati ambientali (23°C ±1°C, 45% RH). Le configurazioni di R&S richiedono l’inserimento manuale, ma anche lì, macro Excel o script Python dovrebbero convalidare i dati rispetto a limiti predefiniti (ad esempio, errori di fase > ±3° segnalano in rosso). Se l’array utilizza il nulling adattivo, registra i rapporti di rifiuto delle interferenze (ad esempio, 30 dB con offset di 20 MHz)—non registrarli può nascondere una perdita del 15% nella resistenza al jamming.

Il monitoraggio nel tempo è critico. Un array a fase basato su GaN potrebbe mostrare una deriva del guadagno di 0.05 dB/mese a causa dell’invecchiamento, quindi i file storici devono includere le date di calibrazione e gli ID degli strumenti. Per i radar militari, i registri conformi alla normativa ISO devono sopravvivere a oltre 10 anni di audit, con checksum SHA-256 per prevenire manomissioni. Se il sistema ha routine di auto-calibrazione, memorizza i coefficienti di correzione (ad esempio, -0.3 dB @ Ch14) separatamente dai dati grezzi per evitare confusione.